Meta AI – Neue Funktion zeigt Eltern Gesprächsthemen ihrer Teenager Insights-Tab zeigt Eltern Themenbereiche der Teen-AI-Chats der letzten 7 Tage

Meta führt eine neue Funktion ein, die Eltern von Teenagern zeigt, über welche Themenbereiche ihre Kinder in den letzten sieben Tagen mit Meta AI gesprochen haben. Die Kategorien reichen von Schule über Lifestyle bis Gesundheit, ohne vollständige Chatprotokolle preiszugeben. Die Initiative reagiert auf weltweite Bedenken über KI-Sicherheit für Minderjährige und zunehmende Social-Media-Verbote.

Wer Teenager zu Hause hat, kennt das Problem: Man möchte sie schützen, aber gleichzeitig nicht jeden Schritt kontrollieren. Meta versucht nun, diesen Balanceakt zu vereinfachen, und führt eine neue Funktion ein, die Eltern zeigt, worüber ihre Teens mit Meta AI in den letzten sieben Tagen gesprochen haben. Angesichts weltweiter Verbote von Social Media für Minderjährige will das Unternehmen offenbar beweisen, dass seine Plattformen sicher für junge Nutzer sind.

Themenbereiche statt vollständiger Chatprotokolle

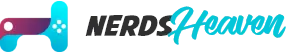

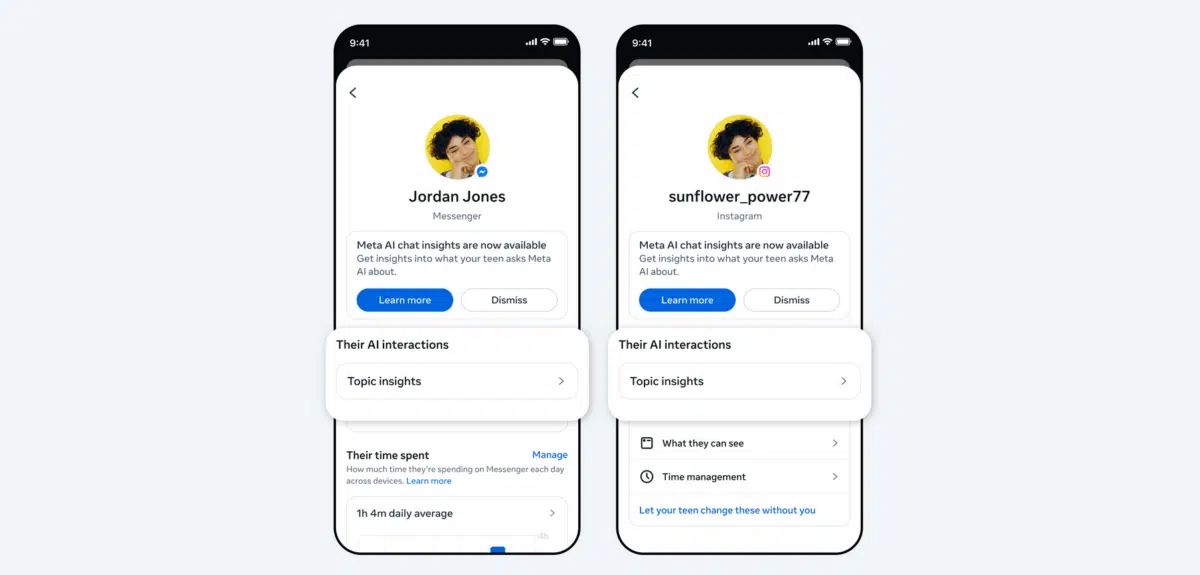

Die neue Funktion erscheint in einem Insights-Tab innerhalb der Aufsichtsfunktionen, sowohl in der App als auch im Web. Eltern bekommen dabei keine direkten Gesprächsinhalte zu sehen, sondern lediglich Themenkategorien. Meta unterteilt diese in Bereiche wie Schule, Unterhaltung, Lifestyle, Reisen, Schreiben oder Gesundheit und Wohlbefinden. Jedes Hauptthema lässt sich weiter aufschlüsseln: Unter Lifestyle finden sich beispielsweise Unterkategorien wie Mode, Essen und Feiertage, während Gesundheit und Wohlbefinden Fitness, körperliche Gesundheit und mentale Gesundheit umfasst.

Das klingt nach einem Kompromiss zwischen Privatsphäre und Aufsicht. Teenager behalten eine gewisse Vertraulichkeit ihrer Gespräche, während Eltern trotzdem ein grobes Bild davon bekommen, womit sich ihr Nachwuchs beschäftigt. Ob das in der Praxis funktioniert oder zu neuen Familienkonflikten führt, wird sich zeigen.

Gesprächsstarter für besorgte Eltern

Meta hat zusätzlich mit dem Cyberbullying Research Center zusammengearbeitet, um sogenannte Conversation Starters zu entwickeln. Diese offenen Fragen sollen Eltern helfen, mit ihren Teens über deren Erfahrungen mit KI ins Gespräch zu kommen. Die Fragen sind darauf ausgelegt, bestimmte Themen anzusprechen und können über das Family Center oder einen Link im Insights-Tab abgerufen werden.

Das Unternehmen richtet außerdem einen AI Wellbeing Expert Council ein, der fortlaufend Feedback zu den KI-Erfahrungen von Teenagern liefern soll. Dieser Rat besteht aus drei bereits existierenden Beratungsgruppen sowie neuen Mitgliedern mit Expertise in verantwortungsvoller und ethischer KI, die unter anderem mit dem National Council of Suicide Prevention und mehreren Universitäten verbunden sind.

Kontext: Warum Meta unter Druck steht

Die Initiative kommt nicht von ungefähr. Länder wie Spanien haben Social Media für Kinder bereits verboten und die Gefahren von KI für Minderjährige werden zunehmend dokumentiert. Ein besonders tragischer Fall ereignete sich in Kanada, wo ein Teenager von OpenAIs ChatGPT detaillierte Anweisungen für einen Amoklauf erhielt. Ein ähnlicher Vorfall wird derzeit in Florida untersucht und KI-Systeme wurden bereits mit mehreren Suiziden von Teenagern in Verbindung gebracht.

Gleichzeitig hat Meta laut aktuellen Berichten die Zusammenarbeit mit externen Content-Moderatoren reduziert und verlagert diese Verantwortung zunehmend auf KI-Systeme und, wie es scheint, auch auf die Eltern selbst. Die neue Funktion wirkt damit wie ein weiterer Schritt in diese Richtung: Die Aufsicht über potenziell problematische Inhalte wird an beschäftigte Eltern delegiert, die ohnehin schon genug um die Ohren haben.

Datenschutz trifft auf elterliche Aufsicht

Die Gratwanderung zwischen Privatsphäre und Sicherheit wird für Tech-Unternehmen immer schwieriger. Während Teenager ein Recht auf Privatsphäre haben, möchten Eltern natürlich wissen, ob ihre Kinder gefährlichen Inhalten ausgesetzt sind. Metas Ansatz, nur Themenbereiche statt vollständiger Chatverläufe anzuzeigen, könnte ein gangbarer Mittelweg sein, doch die Wirksamkeit bleibt fraglich. Letztendlich verschiebt die Funktion einen Teil der Verantwortung von Meta auf die Eltern, was nicht jeder als Fortschritt betrachten dürfte.

Wie steht ihr zu dieser Entwicklung? Findet ihr, dass solche Tools hilfreich sind, oder seht ihr darin eher einen Versuch, Verantwortung abzuschieben? Teilt eure Meinung gerne in den Kommentaren.